A primeira inteligência artificial reconhecida pela história foi o Logic Theorist, um programa criado por Allen Newell e Herbert Simon que conseguia demonstrar teoremas matemáticos de forma autônoma. Esse programa foi apresentado numa conferência em Dartmouth, nos Estados Unidos, e marcou o momento em que a ideia de máquinas que “pensam” saiu do campo da ficção e entrou no campo da ciência.

Mas para entender esse marco, é preciso voltar um pouco mais no tempo. A pergunta “pode uma máquina pensar?” foi formulada muito antes de qualquer computador existir. Ela veio de um matemático britânico que, ao tentar responder essa questão, acabou lançando as bases de tudo que hoje chamamos de inteligência artificial.

Se você já ouviu falar em ChatGPT, reconhecimento de voz ou tradução automática e se perguntou de onde veio tudo isso, a resposta começa aqui. Entender a origem da IA não é apenas curiosidade histórica. É o primeiro passo para compreender como ela funciona, por que ela tem limitações e como usá-la com mais segurança no dia a dia.

Quem inventou a primeira inteligência artificial?

Não existe um único inventor da inteligência artificial. O campo nasceu da contribuição de várias pessoas ao longo de décadas, mas alguns nomes são fundamentais para entender essa história.

Alan Turing foi o primeiro a formular, de forma rigorosa, a pergunta sobre se máquinas poderiam pensar. Sua contribuição foi teórica, mas absolutamente essencial: ele criou o modelo conceitual de uma máquina capaz de processar qualquer tipo de instrução lógica.

Depois de Turing, dois pesquisadores americanos, Allen Newell e Herbert Simon, desenvolveram o Logic Theorist, considerado o primeiro programa de inteligência artificial. Esse software conseguia resolver problemas de lógica matemática de maneira autônoma, algo inédito para a época.

O nome “inteligência artificial” em si foi cunhado por John McCarthy, um cientista da computação que organizou a famosa Conferência de Dartmouth, evento que oficializou a IA como campo de pesquisa. McCarthy argumentava que era possível descrever o aprendizado humano com tanta precisão que uma máquina poderia simulá-lo.

Esses três pilares, Turing como pensador teórico, Newell e Simon como criadores práticos, e McCarthy como organizador e nomeador do campo, formam a base de quem “inventou” a inteligência artificial. Para entender o que significa inteligência artificial hoje, é essencial conhecer esses fundadores.

Qual foi o primeiro software capaz de simular lógica?

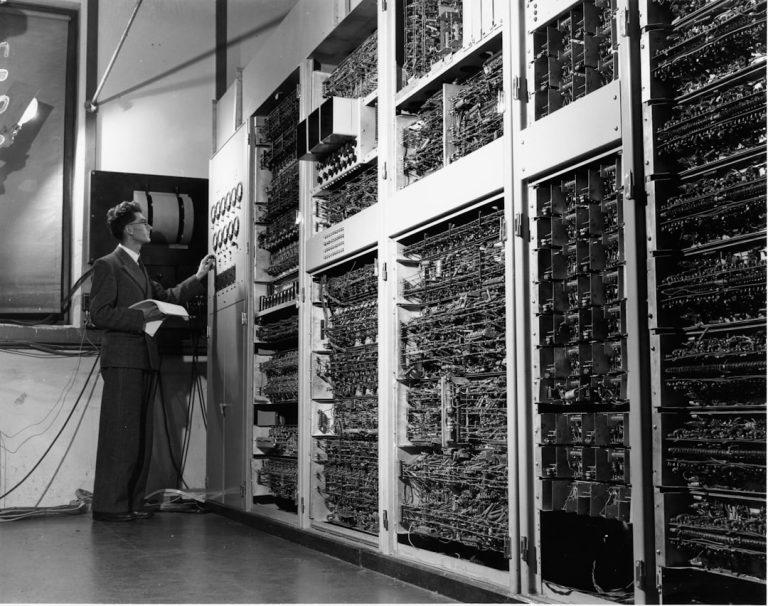

O Logic Theorist é amplamente considerado o primeiro software com características que hoje associamos à inteligência artificial. Ele foi desenvolvido por Allen Newell, Herbert Simon e J.C. Shaw, e sua missão era provar teoremas matemáticos que até então só podiam ser resolvidos por seres humanos.

O programa não seguia um roteiro fixo de respostas. Ele avaliava possibilidades, testava caminhos lógicos e chegava a conclusões por conta própria. Esse comportamento, escolher entre alternativas para resolver um problema, é exatamente o que distingue um programa inteligente de uma simples calculadora.

Logo depois, os mesmos pesquisadores criaram o General Problem Solver, um sistema ainda mais ambicioso que tentava replicar a forma como seres humanos resolvem problemas em geral, não apenas matemáticos. Era uma tentativa de modelar o raciocínio humano dentro de uma máquina.

Esses primeiros softwares eram rudimentares pelos padrões atuais, mas representaram uma virada: provaram que era tecnicamente possível criar programas que tomassem decisões baseadas em regras lógicas. Esse princípio ainda está presente em muitas ferramentas de IA que usamos hoje, como os algoritmos que organizam resultados de pesquisa ou recomendam conteúdo.

Como surgiu oficialmente o termo inteligência artificial?

O termo “inteligência artificial” foi usado pela primeira vez por John McCarthy numa proposta de conferência científica. McCarthy queria reunir pesquisadores de diferentes áreas para investigar, de forma sistemática, se era possível fazer máquinas simular aspectos da inteligência humana.

A escolha do nome foi deliberada e estratégica. McCarthy precisava de um termo que descrevesse o campo de forma clara, sem confundir com automação industrial ou cálculo matemático simples. A palavra “inteligência” sinalizava algo mais profundo: a capacidade de aprender, raciocinar e resolver problemas novos.

A conferência, realizada no Dartmouth College, reuniu algumas das mentes mais brilhantes da época. Ali foram discutidas ideias sobre linguagem, raciocínio, aprendizado e até criatividade em máquinas. Muitas dessas questões continuam abertas até hoje.

O que nasceu naquele encontro não foi apenas um nome. Foi o reconhecimento formal de que a inteligência artificial era um campo legítimo de pesquisa científica. A partir dali, universidades, governos e empresas começaram a investir sistematicamente no tema. Se quiser entender como esse campo chegou até o presente, vale conhecer também o que é a inteligência artificial generativa, a versão mais avançada e popular desse conceito hoje.

Quais foram os marcos iniciais da inteligência artificial?

A história da IA não é uma linha reta. É uma sequência de entusiasmos, avanços, frustrações e recomeços. Mas alguns momentos se destacam como pontos de virada.

O primeiro grande marco foi teórico: a publicação de Alan Turing propondo que máquinas poderiam pensar. Esse texto mudou a forma como cientistas e filósofos encaravam a relação entre mente e máquina.

O segundo marco foi prático: o Logic Theorist provando que um programa podia resolver problemas de forma autônoma. Esse momento transformou uma ideia abstrata em algo concreto e testável.

O terceiro foi organizacional: a Conferência de Dartmouth unindo pesquisadores e criando um campo científico reconhecido. A partir dali, a inteligência artificial ganhou nome, identidade e agenda de pesquisa.

Entre esses marcos iniciais, nenhum é mais importante do que o trabalho de Turing. Não porque ele tenha criado uma máquina inteligente, mas porque ele fez a pergunta certa. E perguntas certas, na ciência, valem mais do que respostas rápidas.

O que foi a máquina de Turing e sua relação com a IA?

A Máquina de Turing não é um equipamento físico. É um modelo teórico criado por Alan Turing para descrever como qualquer problema lógico pode ser resolvido seguindo uma série de regras simples.

O modelo imagina uma fita infinita dividida em quadrados, um cursor que lê e escreve símbolos nessa fita, e um conjunto de instruções que define o que fazer em cada situação. Parece simples, mas esse modelo consegue representar qualquer cálculo ou raciocínio lógico possível.

A importância para a inteligência artificial é direta: Turing mostrou que, se o pensamento humano pode ser descrito como uma sequência de operações lógicas, então uma máquina construída com base nesse modelo pode, em teoria, pensar.

Esse raciocínio foi revolucionário. Ele transformou a questão filosófica “pode uma máquina pensar?” numa questão técnica: “como construímos uma máquina que siga instruções complexas o suficiente para parecer que pensa?” Essa mudança de perspectiva é o que abriu caminho para tudo que veio depois, desde os primeiros programas até os sistemas de IA que usamos hoje para usar inteligência artificial no WhatsApp ou gerar textos automaticamente.

Como o teste de Turing influenciou o desenvolvimento da IA?

O Teste de Turing foi proposto como uma forma prática de avaliar se uma máquina poderia ser considerada inteligente. A ideia central é simples: se uma pessoa conversa com uma máquina por texto e não consegue distingui-la de um ser humano, então essa máquina pode ser considerada inteligente para fins práticos.

Esse teste influenciou profundamente o desenvolvimento da IA por dois motivos. Primeiro, ele deslocou o debate filosófico para o campo da observação: o que importa não é saber se a máquina “realmente pensa”, mas sim se ela se comporta de forma indistinguível de algo que pensa.

Segundo, ele estabeleceu a linguagem natural como um dos grandes desafios da IA. Para passar no teste, uma máquina precisaria entender perguntas, interpretar contexto, responder com coerência e até demonstrar senso de humor. Isso direcionou décadas de pesquisa para o processamento de linguagem.

Hoje, modelos como o ChatGPT são frequentemente descritos como capazes de “passar no Teste de Turing” em conversas casuais. Mas o próprio Turing não pretendia que o teste fosse definitivo. Ele era um ponto de partida, não uma linha de chegada. Entender essa distinção ajuda a usar ferramentas de IA com mais clareza e senso crítico, que é exatamente o tipo de autonomia que o aprendizado consciente de inteligência artificial busca desenvolver.

Quais são as principais abordagens da IA desde o início?

Desde os primeiros experimentos, pesquisadores seguiram caminhos diferentes para tentar criar máquinas inteligentes. Essas abordagens evoluíram com o tempo, mas as divisões fundamentais já estavam presentes desde o início.

A primeira grande divisão foi entre quem acreditava que a IA deveria ser construída com regras explícitas (se acontece X, faça Y) e quem defendia que a máquina deveria aprender por experiência, como os seres vivos fazem.

A abordagem baseada em regras dominou as primeiras décadas. Era mais fácil de programar e de explicar. Mas tinha um limite claro: o mundo real é cheio de situações que nenhuma lista de regras consegue prever completamente.

A abordagem baseada em aprendizado era mais ambiciosa e mais difícil de implementar. Ela exigia grandes quantidades de dados e poder computacional que simplesmente não existiam nas décadas iniciais. Só com o aumento do poder dos computadores e a disponibilidade de dados em massa é que essa abordagem ganhou força e se tornou o motor das IAs modernas.

Entender essa divisão ajuda a compreender por que a IA atual funciona de forma tão diferente dos primeiros sistemas e por que ela ainda tem limitações importantes.

Qual a diferença entre inteligência artificial fraca e forte?

Essa distinção é uma das mais importantes para entender o que a IA realmente faz hoje e o que ainda está fora do seu alcance.

A inteligência artificial fraca, também chamada de IA estreita, é projetada para fazer uma coisa específica muito bem. Um sistema que reconhece rostos, outro que recomenda músicas, outro que traduz textos. Cada um é especialista na sua tarefa e não consegue fazer nada além disso.

Toda a inteligência artificial que existe hoje é fraca nesse sentido. Quando você pede para o ChatGPT escrever um texto ou usa um aplicativo para editar fotos com inteligência artificial, está interagindo com sistemas muito competentes em tarefas específicas, mas sem nenhuma compreensão real do mundo.

A inteligência artificial forte, por outro lado, seria uma máquina capaz de raciocinar, aprender e se adaptar a qualquer situação da mesma forma que um ser humano. Ela entenderia contexto, teria objetivos próprios e poderia transferir conhecimento de uma área para outra.

Essa versão da IA não existe. É um objetivo teórico que pesquisadores debatem há décadas, sem consenso sobre se é possível ou desejável. Saber dessa diferença é fundamental para não superestimar nem subestimar o que as ferramentas de IA podem fazer por você.

Como as redes neurais artificiais começaram a ser pensadas?

A ideia de criar máquinas inspiradas no funcionamento do cérebro humano surgiu logo nos primeiros anos da IA. O objetivo era construir sistemas que aprendessem por tentativa e erro, assim como os neurônios biológicos se fortalecem com o uso.

O primeiro modelo formal de neurônio artificial foi proposto por Warren McCulloch e Walter Pitts, dois pesquisadores que tentaram descrever matematicamente como um neurônio processa sinais. Era um modelo simplificado, mas apontava para a possibilidade de construir redes de processamento baseadas no cérebro.

Depois deles, Frank Rosenblatt criou o Perceptron, considerado o ancestral direto das redes neurais modernas. Era um sistema que aprendia a classificar imagens simples a partir de exemplos, sem que ninguém precisasse programar regras explícitas.

O entusiasmo foi grande, mas também foram grandes as frustrações iniciais. As redes neurais da época eram muito limitadas e exigiam recursos computacionais que simplesmente não existiam. O campo foi abandonado por décadas até que o aumento do poder de processamento e a disponibilidade de dados permitiram retomar essa abordagem com resultados surpreendentes.

Hoje, as redes neurais artificiais são a tecnologia por trás dos sistemas de IA mais avançados do mundo, incluindo os que geram textos, imagens e até vídeos.

Quais os dilemas éticos surgidos com a primeira IA?

Os dilemas éticos da inteligência artificial não são uma novidade do século XXI. Eles estão presentes desde o início do campo, e alguns dos maiores pesquisadores da área foram os primeiros a levantá-los.

O próprio Alan Turing refletiu sobre as implicações de criar máquinas que pensam. Se uma máquina pode raciocinar, ela pode tomar decisões prejudiciais? Quem é responsável por essas decisões? Essas perguntas pareciam abstratas na época, mas se tornaram urgentes décadas depois.

Outro dilema surgido cedo foi o da substituição humana. Desde os primeiros programas capazes de resolver problemas matemáticos, surgiu a preocupação: se uma máquina pode fazer o que um especialista humano faz, o que acontece com esse especialista?

Há também a questão da responsabilidade. Quando um sistema automático toma uma decisão errada, quem responde por isso? O programador? A empresa? O usuário? Esse debate, que começou de forma teórica, hoje é uma questão jurídica e regulatória concreta em vários países.

Por fim, existe o dilema do controle. Quanto mais sofisticada a IA, mais difícil se torna entender por que ela chegou a determinada conclusão. Isso levanta uma questão que afeta diretamente quem usa essas ferramentas no dia a dia: como confiar numa resposta que você não consegue verificar?

Desenvolver essa capacidade crítica, de usar a IA sem depender cegamente dela, é exatamente o que diferencia alguém que usa a tecnologia com autonomia de alguém que apenas segue o que a máquina diz. Se você quer dar esse passo, entender a história e os fundamentos da IA é o melhor começo. E se quiser saber como isso se aplica na prática hoje, vale explorar como você pode usar a inteligência artificial no seu cotidiano de forma consciente e segura.