A inteligência artificial não consegue sentir, julgar com ética própria, ter consciência ou agir com intenção genuína. Por mais impressionante que seja o que ela faz, há uma fronteira clara entre processar dados com sofisticação e compreender o mundo como um ser humano faz.

Essa distinção importa, especialmente para quem quer usar a IA com mais segurança e clareza no trabalho e na vida cotidiana. Entender o que ela não faz é tão útil quanto saber o que ela faz bem.

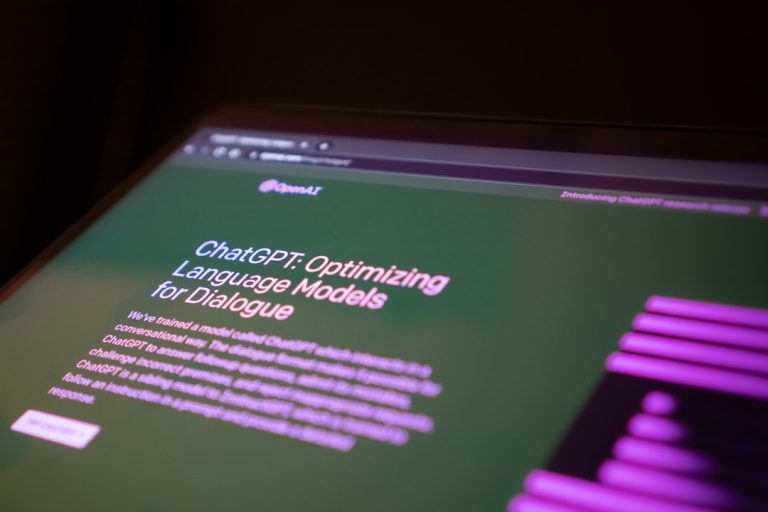

Nos últimos anos, ferramentas como o ChatGPT e outros sistemas de IA generativa avançaram de forma impressionante. Elas escrevem textos, analisam dados, traduzem idiomas e até criam imagens. Mas esse avanço técnico criou um ruído enorme: muita gente passou a achar que a IA pode tudo, ou que vai substituir tudo.

A realidade é mais equilibrada. A inteligência artificial é uma tecnologia poderosa com limitações bem definidas, tanto técnicas quanto humanas e legais. Conhecer esses limites ajuda a usar a ferramenta com mais inteligência e menos ansiedade.

Como a inteligência artificial realmente funciona?

A inteligência artificial, na prática, é um sistema que aprende padrões a partir de grandes volumes de dados e usa esses padrões para gerar respostas ou realizar tarefas. Ela não pensa, não entende e não tem intenção. Ela reconhece e reproduz.

Os modelos de linguagem, por exemplo, foram treinados com bilhões de textos da internet, livros e outras fontes. Quando você faz uma pergunta, o sistema calcula qual sequência de palavras tem maior probabilidade de ser uma resposta adequada, com base no que aprendeu durante o treinamento.

Isso é diferente de raciocinar. É diferente de compreender. E é muito diferente de ter uma opinião formada ou uma experiência vivida.

Para entender melhor como esse processo funciona por baixo dos panos, vale conhecer conceitos como machine learning, o aprendizado de máquina que está na base da maioria dos sistemas de IA modernos. Também é útil entender o papel dos algoritmos, que são as instruções que orientam como a IA processa as informações.

Em resumo: a IA é muito boa em tarefas baseadas em reconhecimento de padrões. Ela falha, e falha com frequência, quando a tarefa exige julgamento humano, contexto emocional ou responsabilidade real.

O que a IA não consegue fazer que os humanos fazem?

Existe um conjunto de capacidades humanas que a inteligência artificial não replica, independentemente de quanto ela melhore tecnicamente. Não se trata de limitação temporária, mas de diferença estrutural entre o que é uma máquina e o que é um ser humano.

Entre os principais pontos onde a IA fica para trás estão:

- Criatividade genuína: a IA combina o que já existe. Ela não cria a partir de uma experiência vivida ou de uma emoção real.

- Julgamento ético: a IA pode identificar padrões relacionados a dilemas morais, mas não consegue assumir responsabilidade por uma decisão ou sentir o peso dela.

- Consciência e intenção: a IA não sabe que existe. Ela não tem propósito próprio nem vontade de alcançar algo.

- Empatia e emoções reais: ela pode simular respostas empáticas, mas não sente nada. Não há experiência subjetiva por trás das palavras.

Esses limites têm implicações diretas para o trabalho, para as relações humanas e para as decisões que tomamos todos os dias.

A IA pode ter criatividade e espontaneidade genuínas?

Não. O que a IA faz é recombinar padrões existentes de formas que parecem novas, mas sempre partem do que já foi criado por humanos. Ela não tem experiências, memórias afetivas ou perspectivas únicas que alimentem uma criação original.

Um escritor humano escreve a partir de perdas, alegrias, medos e descobertas pessoais. Um músico compõe influenciado por tudo que viveu. A IA não viveu nada. Ela foi treinada com o registro do que outros viveram.

A espontaneidade também está fora do alcance da IA. Ela responde ao que é perguntado, dentro dos padrões que aprendeu. Não age por impulso, não muda de ideia por uma intuição e não surpreende a si mesma com uma descoberta inesperada.

Isso não significa que a IA não seja útil para processos criativos. Ela pode ajudar a explorar variações, sugerir alternativas e acelerar etapas do trabalho criativo. Mas a faísca inicial, a escolha do que dizer e o significado por trás da obra continuam sendo humanos.

A inteligência artificial consegue tomar decisões éticas?

Não de forma autônoma e responsável. A IA pode ser programada para seguir regras éticas, mas isso é diferente de tomar uma decisão ética de verdade.

Uma decisão ética envolve ponderar valores que muitas vezes entram em conflito, considerar consequências para pessoas reais e assumir responsabilidade pelo resultado. A IA não carrega esse peso. Ela não sofre consequências, não tem nada a perder e não responde pelos erros que comete.

Além disso, os sistemas de IA podem reproduzir e amplificar vieses presentes nos dados com que foram treinados. Se os dados refletem discriminação, a IA pode reforçá-la sem perceber, porque ela não tem consciência moral para questionar o que aprendeu.

Por isso, decisões com impacto real sobre pessoas, como contratações, diagnósticos médicos ou concessão de crédito, não devem ser delegadas inteiramente à IA. O julgamento humano precisa estar presente.

A IA pode ter intenção e consciência próprias?

Não. A IA não tem consciência de si mesma nem intenção real. Ela executa o que foi programada para executar, com base nos padrões que aprendeu. Quando parece que ela “quer” algo, é uma ilusão criada pela forma como ela formula respostas.

Consciência, no sentido humano, envolve ter uma perspectiva subjetiva sobre o mundo, saber que você existe e que suas ações têm significado. Nenhum sistema de IA atual possui isso. Os modelos mais avançados são extremamente sofisticados no processamento de linguagem, mas não “sabem” que estão respondendo. Eles simplesmente respondem.

Essa distinção é importante para não atribuir à IA características que ela não tem. Quando um modelo de linguagem diz “eu acho” ou “eu sinto”, isso é uma estrutura linguística aprendida, não uma expressão de estado interno real.

Entender isso ajuda a usar a ferramenta com mais clareza: ela é um instrumento poderoso, não um agente com vontade própria.

A IA consegue sentir emoções como remorso e empatia?

Não. A IA pode identificar padrões emocionais em textos e gerar respostas que parecem empáticas, mas não há nenhuma experiência emocional por trás disso. Não existe tristeza, alegria, culpa ou empatia genuína em um sistema de IA.

O remorso, por exemplo, pressupõe reconhecer que uma ação causou dano, sentir o peso disso e desejar ter agido diferente. A IA não tem memória contínua entre conversas, não mantém vínculos com as pessoas com quem interage e não carrega consequências emocionais de nada que produziu.

Isso tem implicações práticas. Uma IA pode gerar uma resposta que cause dano a alguém e, na próxima interação, repetir o mesmo erro sem qualquer registro do que aconteceu. Não há aprendizado emocional nem responsabilidade afetiva.

Por isso, em situações que exigem suporte emocional real, como aconselhamento, cuidado de saúde mental ou decisões pessoais delicadas, a presença humana continua sendo insubstituível.

Quais profissões a inteligência artificial não consegue substituir?

A inteligência artificial avança rapidamente em tarefas repetitivas, baseadas em dados e com regras bem definidas. Mas há profissões onde a presença humana, o julgamento contextual e a relação interpessoal são o próprio produto do trabalho.

Algumas áreas onde a substituição é improvável no curto e médio prazo:

- Saúde: médicos, enfermeiros e psicólogos precisam de julgamento clínico, escuta ativa e presença humana que a IA não oferece.

- Educação: professores que adaptam a abordagem ao estado emocional do aluno, criam vínculos e motivam vão além do que qualquer sistema automatizado consegue.

- Liderança e gestão: liderar pessoas exige intuição, empatia, autoridade construída na relação e capacidade de lidar com conflitos reais.

- Direito e ética: advogados e juízes precisam interpretar contexto, ponderar valores e assumir responsabilidade por decisões com impacto direto na vida das pessoas.

- Ofícios e trabalhos manuais complexos: muitas profissões que exigem destreza física em ambientes imprevisíveis ainda resistem bem à automação.

O impacto da IA na empregabilidade é real, mas não uniforme. As profissões mais seguras são as que combinam habilidades técnicas com capacidades humanas difíceis de replicar.

Por que habilidades interpessoais são difíceis de replicar pela IA?

Habilidades interpessoais dependem de presença real, história compartilhada, leitura de contexto e ajuste emocional em tempo real. Tudo isso vai além do que qualquer modelo de linguagem consegue fazer.

Quando um profissional percebe que o cliente está ansioso antes mesmo de ele falar, ou quando um colega entende que alguém precisa de espaço e não de conselho, isso é leitura humana do ambiente. A IA processa texto e, em alguns casos, áudio e imagem, mas não sente a tensão de uma reunião nem percebe o que não foi dito.

Negociação, mediação de conflitos, construção de confiança ao longo do tempo e comunicação em situações delicadas são exemplos de habilidades que dependem da humanidade de quem as exerce. A eficiência técnica da IA não chega perto disso.

Para profissionais que já estão no mercado, investir nessas capacidades é uma forma inteligente de se posicionar em um cenário onde a IA vai assumindo tarefas mais operacionais.

A IA pode substituir líderes e gestores nas empresas?

Não. Liderança é, fundamentalmente, uma relação humana. Um líder eficaz inspira, orienta, toma decisões em ambientes de incerteza e responde pelos resultados, tanto os bons quanto os ruins.

A IA pode ajudar gestores a analisar dados, identificar tendências e automatizar processos administrativos. Mas não pode substituir a presença de alguém que assume responsabilidade, que tem autoridade construída na experiência e que sabe como motivar pessoas em momentos de dificuldade.

Gestores que entendem como a IA está transformando o mundo do trabalho e usam essa tecnologia a favor da equipe têm uma vantagem competitiva real. Mas isso requer julgamento humano sobre quando e como usar a ferramenta, o que a IA não decide por si mesma.

A liderança que depende de carisma, confiança e relações construídas ao longo do tempo permanece sendo um território exclusivamente humano.

Quais habilidades da geração Z a IA ainda não domina?

A geração Z cresceu em um ambiente digital e desenvolve, naturalmente, algumas habilidades que a IA ainda não replica com eficiência. Entre elas estão a navegação por ambiguidade, a capacidade de construir identidade e posicionamento e a habilidade de criar conexões autênticas em redes sociais.

Jovens profissionais também tendem a ser mais ágeis em adaptar comunicação para diferentes audiências e contextos culturais, algo que exige sensibilidade social e atualização constante, não apenas processamento de dados.

Além disso, a capacidade de questionar, de propor narrativas alternativas e de fazer perguntas que ninguém ainda fez é uma habilidade humana que a IA, por definição, não possui. Ela responde com base no que já existe. Quem questiona o que existe é o ser humano.

Isso não significa que a IA não seja útil para essa geração. Significa que as habilidades mais valorizadas continuam sendo aquelas que nenhum algoritmo substitui.

Quais são os limites técnicos da inteligência artificial?

Além das limitações humanas, a IA tem restrições técnicas concretas que muitas pessoas desconhecem. Entender esses limites é essencial para usar a tecnologia com mais segurança e senso crítico.

Os principais limites técnicos incluem:

- Dependência de dados: a IA só é tão boa quanto os dados com que foi treinada. Dados incompletos, tendenciosos ou desatualizados geram resultados problemáticos.

- Falta de senso comum: a IA pode errar em tarefas que qualquer criança resolveria com facilidade, especialmente quando envolvem contexto físico ou lógica cotidiana.

- Ausência de memória contínua: a maioria dos sistemas de IA não mantém memória entre sessões diferentes. Cada conversa começa do zero.

- Alucinações: modelos de linguagem podem gerar informações falsas com aparência de verdade, um problema técnico ainda sem solução definitiva.

- Dificuldade com novidade absoluta: a IA generaliza a partir de padrões conhecidos. Situações completamente novas, sem precedente nos dados de treinamento, costumam gerar respostas inadequadas.

A IA consegue aprender de forma verdadeiramente autônoma?

Não, pelo menos não como os humanos aprendem. O aprendizado de máquina ocorre em ciclos de treinamento controlados por engenheiros, com dados selecionados e objetivos definidos por humanos. A IA não acorda com curiosidade, não decide explorar um novo tema por vontade própria e não aprende com a experiência cotidiana de forma contínua.

Após o treinamento, os modelos são fixos até que sejam retreinados. Eles não evoluem sozinhos com base nas conversas que têm. Isso significa que um modelo pode repetir o mesmo erro indefinidamente, sem qualquer aprendizado espontâneo.

Há pesquisas em andamento sobre sistemas de aprendizado mais autônomos, mas ainda estamos longe de uma IA que aprenda de forma verdadeiramente independente, com a flexibilidade e a amplitude que os humanos têm.

Entender a diferença entre machine learning e inteligência artificial ajuda a ter uma visão mais precisa sobre o que esses sistemas realmente fazem quando “aprendem”.

Por que a IA ainda erra em tarefas simples para humanos?

Porque muitas tarefas que parecem simples para nós envolvem uma quantidade enorme de conhecimento implícito sobre o mundo físico, social e cultural que a IA não possui de forma integrada.

Contar objetos em uma cena, entender que uma piada depende do tom de voz, navegar em um ambiente desconhecido ou reconhecer sarcasmo em uma frase são exemplos de tarefas que humanos resolvem com facilidade, mas que ainda desafiam os sistemas de IA.

Isso acontece porque o aprendizado humano é incorporado, ou seja, está conectado ao corpo, aos sentidos, às emoções e às experiências vividas. A IA aprende a partir de representações simbólicas dessas experiências, o que cria lacunas importantes.

Por isso, antes de confiar cegamente em uma resposta gerada por IA, é sempre válido questionar: esta tarefa exige contexto que a ferramenta pode não ter? A resposta faz sentido com o que eu sei sobre o assunto?

A IA pode ser criativa como artistas e escritores humanos?

A IA produz resultados que parecem criativos, mas o processo é fundamentalmente diferente. Um escritor humano cria a partir de uma visão de mundo construída ao longo de anos de experiências, relações, perdas e descobertas. A IA reorganiza padrões extraídos do que outros já criaram.

Isso não diminui a utilidade das ferramentas criativas de IA. Elas podem acelerar esboços, sugerir variações e ajudar a superar bloqueios. Mas a voz, o ponto de vista e o significado por trás de uma obra continuam sendo humanos.

Há também uma questão de autoria. Quando um artista cria, existe uma história, uma intenção e uma responsabilidade por aquilo que foi feito. A IA não carrega nada disso. O que ela gera não tem origem emocional nem propósito próprio.

Para quem usa ferramentas de IA em processos criativos, o melhor caminho é tratá-las como assistentes, não como substitutos da criatividade humana.

Quais são os limites éticos e legais da inteligência artificial?

Os limites da IA não são apenas técnicos ou humanos. Há um conjunto crescente de questões éticas e legais que moldam como a tecnologia pode e deve ser usada.

Entre os pontos mais relevantes estão:

- Responsabilidade pelos erros: quando a IA causa um dano, quem responde por isso? O desenvolvedor? O usuário? A empresa que implantou o sistema?

- Propriedade intelectual: conteúdos gerados por IA levantam questões sobre autoria, plágio e direitos autorais que os sistemas legais ainda estão tentando responder.

- Privacidade e uso de dados: muitos sistemas de IA foram treinados com dados pessoais, o que levanta questões sérias sobre consentimento e privacidade.

- Transparência: em muitos casos, não é claro como a IA chegou a uma determinada conclusão, o que dificulta a contestação de decisões automatizadas.

Esses debates ainda estão em aberto e as regulações variam significativamente entre países. Usar IA com responsabilidade exige atenção a essas questões, não apenas às capacidades técnicas da ferramenta.

A IA pode ser responsabilizada juridicamente por seus erros?

Não. Do ponto de vista jurídico, a IA não é uma pessoa, não tem personalidade legal e não pode ser processada ou punida. Ela é tratada como uma ferramenta, e a responsabilidade pelos seus erros recai sobre os humanos envolvidos, sejam os desenvolvedores, as empresas que a implementam ou os usuários que a utilizam em contextos inadequados.

Isso cria situações complexas. Se um sistema de IA recomenda um tratamento médico incorreto ou toma uma decisão discriminatória em um processo de contratação, definir quem é responsável pode ser um processo longo e disputado.

Diferentes países estão desenvolvendo regulações específicas para IA, mas o cenário ainda é fragmentado. O que está claro é que a ausência de responsabilidade jurídica da IA torna ainda mais importante o papel humano na supervisão e no uso consciente dessas ferramentas.

Por que a IA não pode ser reconhecida como inventora em patentes?

Porque os sistemas de patentes ao redor do mundo exigem que um inventor seja uma pessoa humana. Invenções precisam ter um autor que possa assumir responsabilidades legais e receber direitos, o que a IA não pode fazer.

Casos concretos já foram levados a tribunais em vários países, sempre com o mesmo resultado: a IA não pode ser nomeada como inventora. O que está em debate é quem, entre os humanos envolvidos, tem o direito sobre algo criado com a ajuda de um sistema de IA.

Essa questão tem implicações práticas importantes para empresas que usam IA em processos de inovação e pesquisa. O desenvolvimento legal nessa área ainda está em curso, mas o princípio atual é claro: a IA é uma ferramenta, não um agente com direitos.

Como garantir a segurança e ética no uso da inteligência artificial?

Garantir o uso ético da IA começa com uma postura crítica de quem a utiliza. Aceitar qualquer resposta sem questionar é um risco, especialmente em decisões que afetam pessoas reais.

Algumas práticas que ajudam a usar a IA com mais segurança:

- Verificar informações importantes em fontes confiáveis antes de agir com base nelas.

- Não delegar à IA decisões que exigem julgamento humano, como avaliações de pessoas ou diagnósticos.

- Estar atento a vieses nos algoritmos, que podem reproduzir discriminações de forma invisível.

- Usar a IA como apoio, não como substituto do próprio raciocínio.

- Questionar quando a resposta parece boa demais ou quando envolve dados que a IA pode não ter acesso atualizado.

O senso crítico continua sendo o recurso mais importante para quem usa IA no dia a dia. Ferramentas não substituem o julgamento de quem as usa.

O que esperar do futuro da inteligência artificial?

O avanço da inteligência artificial vai continuar, e em ritmo acelerado. Mas isso não significa que os limites discutidos aqui vão desaparecer. Alguns são técnicos e podem ser reduzidos com mais pesquisa e poder computacional. Outros são fundamentalmente humanos e não têm solução tecnológica.

O que muda com o tempo é a capacidade da IA de simular cada vez melhor comportamentos humanos, o que exige mais atenção crítica de quem a utiliza. Quanto mais realista for a simulação, mais importante é lembrar que se trata de uma ferramenta, não de um ser.

Para quem quer se preparar para esse cenário, entender a importância da inteligência artificial nos dias de hoje é um bom ponto de partida. Não para acompanhar o hype, mas para tomar decisões mais informadas sobre como e quando usar essas ferramentas.

A inteligência artificial pode superar a humana algum dia?

Essa é uma das perguntas mais debatidas na área, e a resposta honesta é: não sabemos. O que os especialistas chamam de “inteligência artificial geral”, um sistema capaz de realizar qualquer tarefa cognitiva humana com a mesma flexibilidade e profundidade, ainda não existe e não há consenso sobre se e quando poderia existir.

O que existe hoje são sistemas de IA estreita, muito bons em tarefas específicas, mas incapazes de transferir esse conhecimento de forma autônoma para outras áreas. Um modelo de linguagem que escreve textos excepcionais não consegue dirigir um carro nem reconhecer emoções com a precisão de um ser humano.

Mesmo que sistemas mais avançados surjam no futuro, a questão de “superar” a inteligência humana depende do que se entende por inteligência. Velocidade de processamento? A IA já supera os humanos. Julgamento ético, empatia, criatividade genuína e consciência? Ainda são território exclusivamente humano, e não há indicação clara de que isso vá mudar.

Quais áreas a IA ainda vai melhorar nos próximos anos?

Algumas áreas onde o avanço da IA deve ser mais visível e relevante para o dia a dia das pessoas:

- Saúde: diagnóstico por imagem, análise de exames e identificação de padrões em históricos médicos são áreas onde a IA já avança e deve continuar evoluindo.

- Educação personalizada: sistemas capazes de adaptar o ritmo e o conteúdo de aprendizagem a cada aluno têm potencial de transformar a forma como as pessoas aprendem.

- Produtividade profissional: tarefas repetitivas de análise, organização de informações e geração de rascunhos devem ser cada vez mais automatizadas.

- Acessibilidade: tradução em tempo real, transcrição de áudio e ferramentas de comunicação assistida devem se tornar mais precisas e acessíveis.

- Pesquisa científica: a IA já está acelerando descobertas em áreas como biologia molecular e desenvolvimento de materiais.

O impacto da inteligência artificial na vida das pessoas vai aumentar, mas de forma mais útil quando as pessoas souberem usar a tecnologia com clareza, senso crítico e sem abrir mão do que é genuinamente humano.