O termo inteligência artificial foi criado em 1956, durante uma conferência realizada no Dartmouth College, nos Estados Unidos. Foi nesse evento que o matemático John McCarthy propôs oficialmente o nome para descrever a ideia de criar máquinas capazes de simular processos do pensamento humano.

Mas a história que levou até esse momento começa muito antes. Pesquisadores já estudavam lógica, raciocínio automatizado e o funcionamento do cérebro humano décadas antes de alguém dar um nome a tudo isso.

Entender essa origem não é apenas curiosidade histórica. É uma forma de compreender o que a inteligência artificial realmente é, o que ela pode fazer e, principalmente, o que ela não é. E isso faz toda a diferença para quem quer usar essa tecnologia com clareza e segurança no dia a dia.

Qual é a origem histórica do conceito de IA?

A ideia de criar máquinas que pensam não nasceu com os computadores modernos. Ela vem de uma tradição filosófica e científica antiga, que sempre se perguntou se era possível replicar o raciocínio humano em algo não humano.

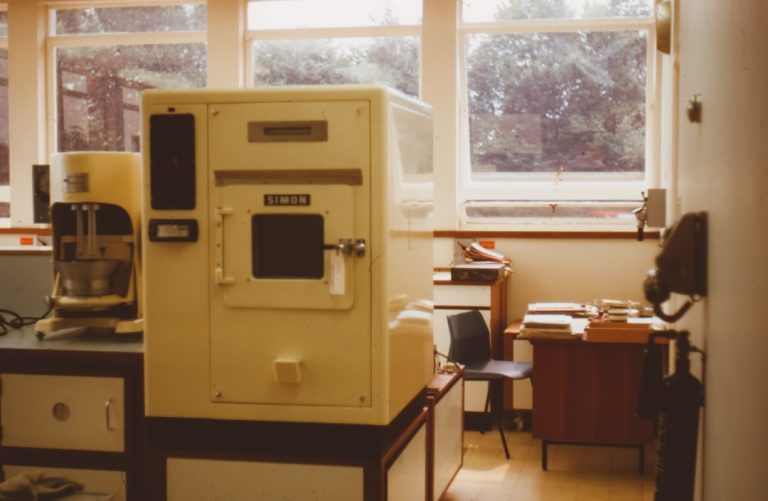

No século XX, com o surgimento dos primeiros computadores e o avanço da matemática, essa pergunta deixou de ser apenas filosófica e passou a ser técnica. Pesquisadores começaram a investigar de forma sistemática como máquinas poderiam processar informações, resolver problemas e até aprender.

Nesse contexto, surgiram os primeiros estudos formais sobre lógica computacional, redes neurais artificiais e modelos matemáticos do cérebro. Cada um desses campos contribuiu para construir a base do que hoje chamamos de inteligência artificial.

O nome só veio depois. Mas o conceito já estava sendo construído em laboratórios, universidades e artigos acadêmicos muito antes de receber um rótulo oficial. Compreender essa linha do tempo ajuda a enxergar a IA como uma área com raízes profundas, e não como uma invenção recente surgida do nada.

Quem criou o termo inteligência artificial?

O criador do termo foi John McCarthy, matemático e cientista da computação norte-americano. Ele propôs a expressão “artificial intelligence” em 1956, ao organizar uma conferência acadêmica voltada especificamente para discutir a possibilidade de criar máquinas inteligentes.

A escolha do nome não foi casual. McCarthy queria uma expressão que comunicasse claramente o objetivo da área: desenvolver sistemas artificiais capazes de executar tarefas que, em seres humanos, exigiriam inteligência.

Outros pesquisadores da época, como Marvin Minsky, Claude Shannon e Nathaniel Rochester, também participaram da organização desse evento e contribuíram para definir os primeiros contornos do campo. Mas foi McCarthy quem ficou associado ao nome que persiste até hoje.

A escolha de uma única expressão para descrever um campo tão amplo gerou, desde o início, debates sobre o que realmente significa “inteligência” em uma máquina. Esses debates continuam relevantes, especialmente agora que ferramentas de IA estão presentes na rotina de milhões de pessoas.

Qual foi a importância da Conferência de Dartmouth?

A Conferência de Dartmouth é considerada o marco fundador da inteligência artificial como campo de estudo independente. Realizada no verão de 1956 no Dartmouth College, em New Hampshire, ela reuniu alguns dos pesquisadores mais importantes da época para discutir, durante semanas, a possibilidade de simular a inteligência humana em máquinas.

Antes desse evento, os estudos que hoje associamos à IA estavam dispersos em diferentes áreas: matemática, neurociência, psicologia, lógica e engenharia. A conferência serviu como ponto de convergência, dando ao campo uma identidade própria e um nome reconhecível.

O resultado prático foi a criação de uma comunidade de pesquisadores com objetivos comuns, que passou a desenvolver os primeiros programas capazes de jogar xadrez, resolver problemas matemáticos e processar linguagem. Esses primeiros sistemas eram rudimentares, mas representavam um ponto de partida concreto para décadas de desenvolvimento.

A conferência de Dartmouth não produziu soluções definitivas. Mas estabeleceu uma direção. E isso, por si só, foi suficiente para transformar a forma como a humanidade passou a pensar sobre máquinas e raciocínio.

Qual o papel de John McCarthy na definição do nome?

McCarthy não apenas criou o termo, como também defendeu ativamente sua adoção diante de colegas que preferiam expressões alternativas, como “ciência dos autômatos” ou “processamento de informação complexa”.

Para ele, o nome “inteligência artificial” tinha uma vantagem clara: era direto e ambicioso. Comunicava exatamente o que o campo pretendia alcançar, sem eufemismos técnicos que dificultassem a compreensão do público geral e dos financiadores de pesquisa.

Ao longo de sua carreira, McCarthy também desenvolveu a linguagem de programação LISP, amplamente usada em pesquisas de IA nas décadas seguintes, e contribuiu com conceitos fundamentais para o campo. Ele permaneceu ativo na área por décadas, sempre defendendo uma visão rigorosa e científica do que a inteligência artificial poderia, e deveria, ser.

Seu papel vai além da criação de um nome. McCarthy ajudou a moldar a identidade intelectual de uma área que, muitas décadas depois, se tornaria uma das mais influentes do mundo.

O que existia antes da oficialização do termo?

Antes de 1956, não existia o campo chamado “inteligência artificial”, mas existiam pesquisas importantes que prepararam o terreno para ele. Matemáticos, lógicos e engenheiros já trabalhavam com questões que hoje reconhecemos como parte da IA.

Entre os temas mais estudados estavam: a lógica formal e como ela poderia ser automatizada, os primeiros modelos matemáticos de neurônios artificiais e a ideia de que máquinas poderiam ser programadas para resolver problemas complexos.

Esses estudos não usavam o nome “inteligência artificial”, mas exploravam exatamente as mesmas perguntas fundamentais: máquinas podem pensar? Como se aprende? É possível representar o conhecimento em linguagem matemática?

A resposta a essas perguntas foi sendo construída aos poucos, por pesquisadores de diferentes países e áreas. O que a Conferência de Dartmouth fez foi, essencialmente, reunir essas ideias sob um mesmo teto e dar a elas um nome comum.

Como os estudos de Alan Turing influenciaram a área?

Alan Turing é uma das figuras mais importantes na pré-história da inteligência artificial. Matemático britânico, ele desenvolveu conceitos fundamentais sobre computação e, mais relevante para esse contexto, foi um dos primeiros a formular publicamente a pergunta: as máquinas podem pensar?

Em um artigo publicado em 1950, Turing propôs o que ficou conhecido como o “Teste de Turing”: um experimento mental no qual uma máquina seria considerada inteligente se conseguisse imitar respostas humanas de forma convincente o suficiente para enganar um avaliador.

Esse teste não era uma solução técnica, mas uma forma de recolocar a questão de maneira mais prática. Em vez de perguntar “as máquinas pensam?”, Turing sugeriu perguntar “as máquinas conseguem se comportar como se pensassem?” Essa mudança de perspectiva influenciou gerações de pesquisadores.

Turing também desenvolveu a ideia da “máquina universal”, um modelo teórico que demonstrava a capacidade de uma máquina executar qualquer computação possível. Esse conceito é a base de todos os computadores modernos e, por extensão, de todos os sistemas de inteligência artificial que conhecemos hoje. Para entender melhor como tudo isso se conecta, vale conhecer qual foi a primeira inteligência artificial da história.

Como a inteligência artificial evoluiu com o tempo?

Depois da Conferência de Dartmouth, a inteligência artificial passou por ciclos de entusiasmo e decepção. Houve períodos de grande investimento e otimismo, seguidos de fases de estagnação, quando as promessas não se traduziram em resultados práticos.

Com o tempo, a área foi amadurecendo. Novas abordagens surgiram, computadores ficaram mais poderosos e a quantidade de dados disponíveis para treinar sistemas aumentou de forma expressiva. Esses fatores combinados criaram as condições para o avanço que vivemos hoje.

Hoje, a inteligência artificial está presente em ferramentas de uso cotidiano: assistentes de voz, sistemas de recomendação, tradutores automáticos, geradores de texto e imagem. O caminho entre as primeiras ideias da década de 1950 e esses aplicativos foi longo, mas cada etapa contribuiu para chegar até aqui.

Entender essa evolução ajuda a ter uma visão mais realista sobre o que a IA é capaz de fazer hoje, e o que ainda está em desenvolvimento. Isso é especialmente útil para quem quer aprender a usar inteligência artificial de forma consciente e segura.

A transição da IA simbólica para o aprendizado de máquina

Nos primeiros décadas da inteligência artificial, a abordagem dominante era a chamada IA simbólica. Nessa visão, a inteligência era representada por regras lógicas explícitas, programadas diretamente pelos pesquisadores. O sistema seguia instruções do tipo “se isso acontecer, faça aquilo”.

Essa abordagem funcionava bem em ambientes controlados, mas tinha um limite claro: o mundo real é complexo demais para ser descrito por regras fixas. Os sistemas simbólicos não conseguiam lidar bem com incerteza, ambiguidade ou situações imprevistas.

Com o avanço dos computadores e a disponibilidade de grandes volumes de dados, uma nova abordagem ganhou força: o aprendizado de máquina. Em vez de programar regras, os pesquisadores passaram a ensinar os sistemas a aprender padrões a partir de exemplos. O sistema não recebe instruções diretas, ele descobre padrões nos dados por conta própria.

Essa transição foi gradual e não significa que a IA simbólica desapareceu. Mas o aprendizado de máquina, especialmente nas suas versões mais recentes envolvendo redes neurais artificiais, é o que impulsiona a maioria das ferramentas de IA que existem hoje.

Quais são os principais tipos de inteligência artificial?

Quando falamos em inteligência artificial, não estamos falando de uma coisa só. A área engloba sistemas com capacidades muito diferentes, que podem ser organizados em categorias para facilitar a compreensão.

A divisão mais comum separa a IA em dois grandes grupos: a inteligência artificial limitada, que é o que existe hoje, e a inteligência artificial geral, que ainda é um objetivo teórico para o futuro.

Essa distinção é importante porque boa parte da confusão em torno do tema vem de misturar essas duas categorias. Quando alguém diz que “a IA vai substituir os humanos”, geralmente está falando de um tipo de inteligência que ainda não existe. O que temos disponível hoje é algo muito mais específico e restrito, ainda que impressionante em diversas aplicações.

Conhecer esses tipos ajuda a usar as ferramentas disponíveis com mais clareza e a separar o que é real do que ainda é especulação. Para aprofundar essa compreensão, vale explorar também o que significa inteligência artificial na prática.

O que define a inteligência artificial limitada?

A inteligência artificial limitada, também chamada de IA estreita ou fraca, é o tipo que existe hoje em todas as ferramentas disponíveis para uso. Ela é chamada de “limitada” porque foi projetada para realizar tarefas específicas, e não para pensar de forma ampla como um ser humano.

Um assistente de voz reconhece fala e responde perguntas, mas não consegue dirigir um carro. Um sistema de recomendação sugere filmes com base no seu histórico, mas não sabe jogar xadrez. Cada ferramenta foi treinada para um conjunto definido de tarefas, dentro de um domínio específico.

Isso não significa que esses sistemas são simples. Ferramentas como os geradores de texto e as que permitem entender o que é inteligência artificial generativa são extremamente sofisticadas dentro do que fazem. Mas elas não têm consciência, não entendem o mundo da forma que humanos entendem e não operam fora do escopo para o qual foram treinadas.

Compreender esse limite é fundamental para usar a IA com responsabilidade: saber o que ela pode fazer bem e onde ela falha é parte do uso consciente da tecnologia.

O que se espera da inteligência artificial geral?

A inteligência artificial geral, conhecida pela sigla AGI em inglês, representa a ideia de uma máquina capaz de raciocinar, aprender e resolver problemas em qualquer domínio, da mesma forma que um ser humano faria.

Diferente dos sistemas atuais, uma AGI teórica não precisaria ser treinada separadamente para cada tarefa. Ela seria capaz de transferir conhecimento entre áreas diferentes, adaptar-se a situações novas e, possivelmente, desenvolver objetivos próprios.

Esse tipo de inteligência ainda não existe. Pesquisadores debatem se ela é tecnicamente possível, quando poderia surgir e quais seriam suas implicações. Não há consenso sobre nenhuma dessas questões.

O que é importante entender é que tudo o que se usa hoje, desde os chatbots até os sistemas que geram imagens com inteligência artificial, pertence à categoria da IA limitada. A distância entre o que temos hoje e uma inteligência geral é ainda muito grande, apesar dos avanços recentes.

Por que o termo inteligência artificial é tão relevante?

O nome “inteligência artificial” carrega uma promessa grande. E é justamente por isso que ele gera tanto fascínio, mas também tanta confusão.

A palavra “inteligência” sugere capacidades humanas: compreensão, julgamento, criatividade. Isso cria expectativas que os sistemas atuais nem sempre conseguem cumprir, e alimenta medos sobre o que essas máquinas poderiam fazer no futuro.

Por outro lado, o termo também ajudou a dar visibilidade e legitimidade a uma área de pesquisa que, sem um nome forte, poderia ter demorado mais para receber atenção e investimento.

Hoje, décadas após a Conferência de Dartmouth, o nome permanece o mesmo, mas o campo evoluiu de formas que seus criadores não poderiam imaginar completamente. Ferramentas de IA estão acessíveis a qualquer pessoa com um celular, sendo usadas para usar inteligência artificial no WhatsApp, editar fotos, redigir textos e muito mais.

Saber de onde veio esse nome, quem o criou e o que ele representa é o primeiro passo para usar essa tecnologia com clareza. Não como algo misterioso ou assustador, mas como uma ferramenta que tem história, limites e um potencial real que qualquer pessoa pode aprender a explorar com segurança.